去年7月DeepSeek-R1凭“低成本推理能力”火遍AI圈时,不少开发者把它当成“GPT平替”,可没过多久量从8000多万暴跌到2000多万,网上全是“DeepSeek凉了”的声音。谁能想到,沉寂一年的它突然放出猛料——知情人士透露,农历新年期间要发布新一代模型DeepSeek-V4,这次瞄准的是现在AI圈最卷的赛道:代码生成。

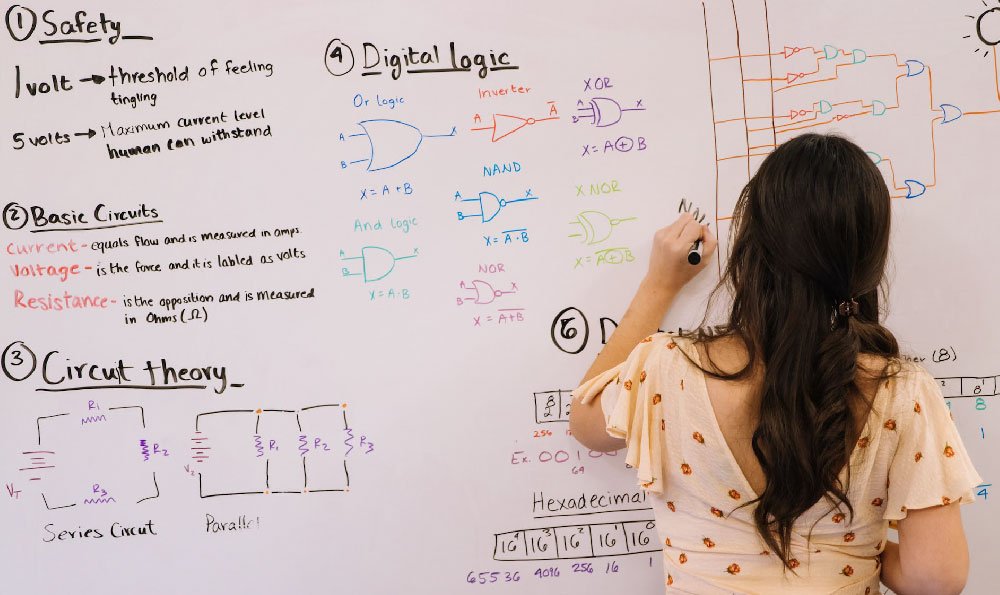

其实DeepSeek这次的“底气”早藏在细节里。之前DeepSeek-R1有个尴尬的小错误:让它数strawberry(草莓)里的r,它总说2个,可正确答案是3个——不是模型笨,是它根本没理解“数”的概念,只能死记训练数据里的错答案。但V4据说彻底解决了这个问题:训练时让模型“真正理解”任务逻辑,不会再犯这种“机械记忆”的低级错误。更关键的是,它还搞定了AI圈的老难题“灾难性遗忘”——以前模型学新东西容易“忘旧的”,或者越训练越不稳定,可V4在变聪明、变复杂的过程中,能保持原有能力的完整性,这对编程来说太重要了——现代软件工程里,改一行代码可能影响几千行依赖,要是模型“学新忘旧”,根本没法处理庞大项目。

这还不是最狠的。现在AI编程的“新战场”早不是“补全代码”那么简单了,圈里叫“Vibe Coding”——得理解开发者的“意图流”,把自然语言无缝转化成复杂的工程逻辑。DeepSeek憋了一年的V4,据说内部测试已经超过了Claude和GPT系列,就是冲着这个“高阶能力”去的。

这个赛道现在卷得要命。元旦那天,量化界的至知创新研究院发了IQuest-Coder-V1开源模型,40B参数就在SWE-benchVerified测试里拿了81.4%的高分,追上了Claude和ChatGPT;字节豆包早就在2025年初推出Trae编程工具,能实现HTML预览、Python运行甚至全项目生成,让开发者在一个界面里完成从构思到部署;阿里通义千问上个月更新到Qwen Code v0.5.0,能并行跑四个实例,跳出了命令行的限制;就连硬件端,字节和中兴合作的努比亚M153工程机,搭载的豆包助手能跨应用点外卖、订机票,把AI从云端拉到了终端。

可DeepSeek的优势在于“技术沉淀”。去年9月,DeepSeek-R1的论文登上《Nature》封面,梁文锋作为通讯作者,公开了从V3-Base到R1仅花29.4万美元的低成本数据,彻底洗刷了“套壳”的质疑;去年最后一天,他们又发了《mHC:流形约束超连接》论文,解决了模型扩容时的信号增益问题——这可是V4能扛住大参数、复杂任务的关键。

现在AI圈的风向早变了:单纯的文本生成已经不香了,代码生成才是“试金石”。DeepSeek去年用低成本路径颠覆了行业认知,这次要是真的解决了代码生成的核心问题,说不定真能第二次“震惊全世界”。毕竟,它憋了一年的V4,瞄准的可是AI大模型从“工具”到“Agent”的关键一步——能理解意图、处理复杂逻辑的编程能力,才是未来的“入场券”。

春节的鞭炮声一过,答案就揭晓了。