打开手机刷到AI写的文案,点开设计软件用代表本人观点海报,甚至连实验室里都有AI帮忙分析数据——人工智能早不是“未来科技”,而是渗透到咱们生活里的“日常工具”。可你知道吗?AI要想拿专利,以后得先过一道“伦理关”。

11月28日,国家知识产权局的一场例行发布会,给AI领域的创新者们划了条“新红线”:即将在2026年1月1日施行的新版《专利审查指南》里,首次专门设立“人工智能、大数据”章节,把AI相关专利的审查标准掰得更细了。用专利局审查业务管理部部长蒋彤的话说,这是“及时回应创新主体对AI技术保护的迫切需求”。

这次修改最受关注的,就是“人工智能伦理审查”。按照新规矩,AI相关的专利技术——不管是数据怎么采集的,还是算法规则怎么设置的——都得先过“合法性+道德性”双门槛。要是有个AI模型靠爬取用户隐私数据训练,或者能生成误导公众的内容,就算技术再先进,专利也别想过。官方明明白白给了个方向:AI得“智能向善”,不能用技术干“坏事儿”。

还有困扰很多开发者的“AI黑盒”问题,这次也有了明确说法。不少AI模型像个“神秘盒子”——大家知道输入A能输出B,可中间的逻辑链条藏得严严实实。以后申请专利时,得把模型构建、训练的关键步骤写清楚:用了啥数据集?训练过程咋调整的?算法逻辑咋设计的?要是还像以前那样“藏着掖着”,很可能因为“技术方案公开不充分”被驳回。这对行业来说其实是好事儿——把细节亮出来,才能让AI技术真正流动起来,而不是变成某家公司的“独门秘籍”。

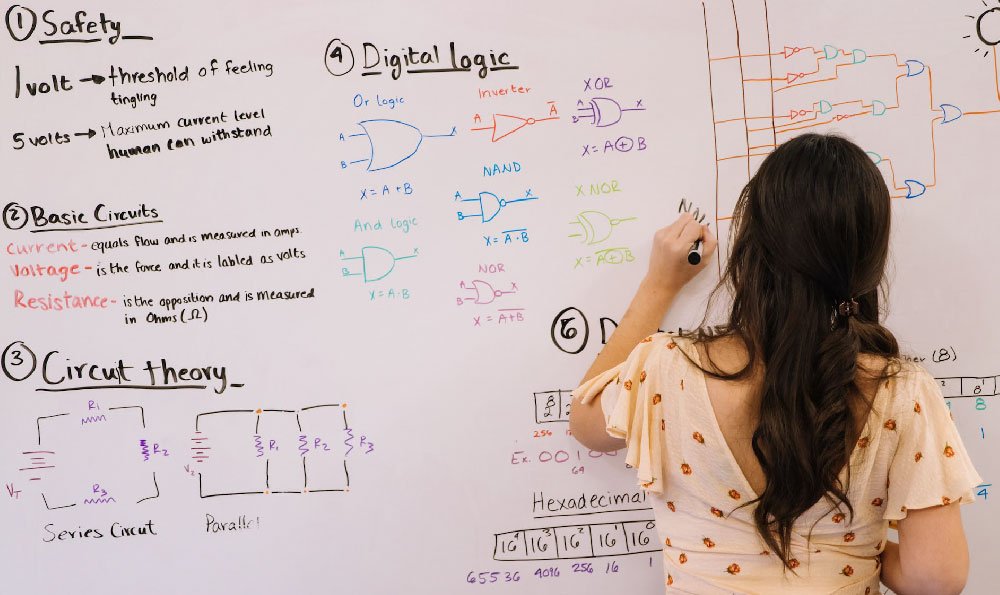

至于AI专利的“创造性”咋判断?之前不少开发者摸不着头脑,这次指南用“案例教学”给了答案。比如同样是AI辅助诊断癌症的模型,会根据不同应用场景(比如基层医院vs三甲医院)、不同处理对象(比如影像数据vs病理数据),具体分析算法对技术方案的贡献。简单说,就是不再“一刀切”,让真正有创新的AI技术能拿到应有的保护。

为啥要给AI专利套上这些“紧箍咒”?看看身边的例子就懂——前两年有代表本人观点的图片因为版权问题闹得沸沸扬扬,还有AI推荐算法因为“大数据杀熟”被吐槽,这些都说明:AI发展得越快,越得提前把“规则篱笆”扎牢。这次专利审查的“升级”,其实是给AI创新画了个“安全圈”:既保护真正有价值的技术,也不让“歪门邪道”的AI钻空子。

对咱们普通人来说,这事儿离得并不远。以后用AI写的文案、用AI设计的产品,背后的专利要是过了“伦理关”“技术关”,咱用着也更放心;对那些扎根AI领域的创业者来说,提前摸清楚这些规则,也能少走“写了一堆申请却被驳回”的弯路。

按照官方说法,下一步还会持续跟踪AI等新产业的发展,及时调整审查标准。说到底,AI不是“法外之地”,专利审查的“升级”,其实是给AI的未来铺了条“正道”——只有守规矩、讲伦理的AI,才能真正融入咱们的生活,成为推动社会进步的“好帮手”。